音楽、詩、テキスト、さらにはプログラミング コード– ChatGPTオープン人工知能プラットフォームでできないことはありますか?世界中の多くの人がこのプラットフォームを使用して問題を解決し、提案を求め、さらには文化コンテンツを作成しています。

この可能性を考慮して、デルフト工科大学とスイス工科大学EPFLの研究者らは、この問題をもう少し深く調査することにしました。たとえば、 ChatGPTだけでロボットを設計することは可能でしょうか?これは設計プロセスにとって良いことでしょうか?それともリスクがあるのでしょうか?

研究者らはまず、 ChatGPTに人類にとって将来の最大の課題は何になるかを尋ねました。研究者のコジモ・デッラ・サンティーナ氏によると、チームはこのプロジェクトが単なるロボットではなく、実際に人々に役立つものになることを望んでいました。

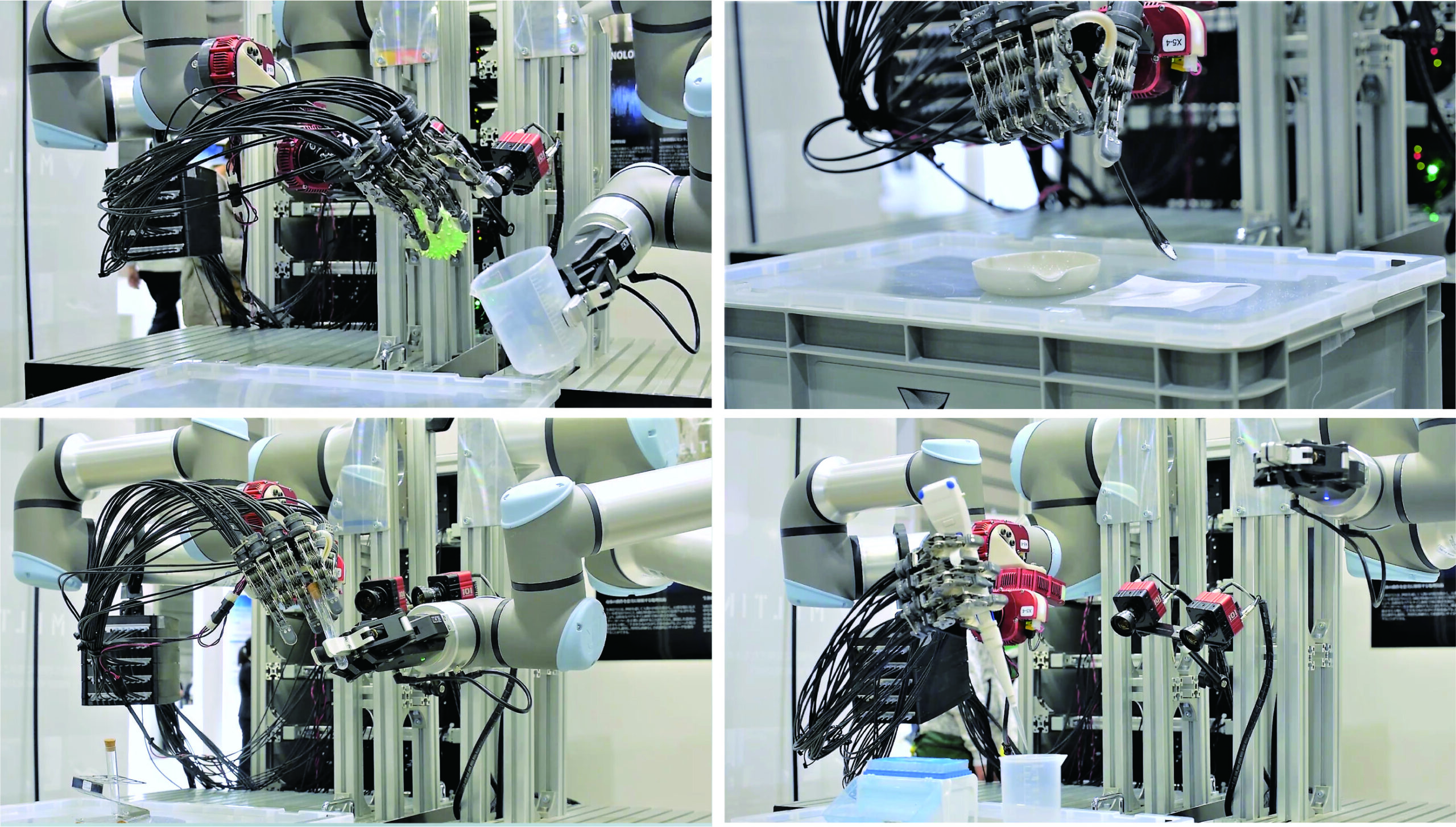

回答によると、研究者らは食料供給の問題に取り組むことを決意し、 ChatGPTとの対話の中で、トマトを収穫するロボットを設計してみるのは興味深いだろうという結論に達したという。

ChatGPT を使用したロボット開発プロセスはどのようなものでしたか?

研究者は、 ChatGPT の設計上のすべての決定に従いました。人工知能の貢献は構想段階で特に価値があり、設計者の知識が他の活動領域に広がりました。

しかし、それだけではありません。ChatGPTは、トマトの損傷を避けるためにグリッパーをシリコンやゴムで作る、ロボットをより効率的に駆動するためにダイナミクセルモーターを使用するなど、実装段階全体を通じて有益な提案も行いました。

その結果、実際にトマトを収穫できるロボットが誕生しました。研究者らによると、 ChatGPTを使用した共同設計プロセスは前向きで充実したものでした。ただし、これは、人間がエンジニアと同様に、より技術的なタスクを実行するように移行していることを意味します。

これは将来のロボット工学プロジェクトに何を意味するのでしょうか?

研究中に、科学者は人間と人工知能の間のさまざまな程度の協力を調査します。最も極端なシナリオでは、AI がプロジェクトのすべての情報を提供し、人間はその指示に盲目的に従うことになります。この場合、AI は研究者およびエンジニアとして機能し、人間はプロジェクトの目標の指定を担当するマネージャーとして機能します。

ただし、そのような極端なシナリオはまだ可能ではなく、望まれない可能性もあります。情報が検証または検証されていない場合、情報は誤解を招く可能性があることが判明しました。

人工知能は、質問に対して最も可能性の高い答えを生成するように設計されていますが、必ずしも正しい答えを生成するとは限りません。したがって、誤った情報や偏見が生じるリスクがあります。さらに、AI と連携すると、盗作、トレーサビリティ、知的財産に関する問題も生じます。

研究者らは現在、研究を拡大して、たとえば、自らの身体を設計する際のAIの自律性や、これらのシステムがどのように世界的なロボット工学の将来において創造的な支援となり得るかなどをさらに解明する予定である。